L’AI di Anthropic ha individuato exploit critici negli smart contract

Crediamo nella completa trasparenza con i nostri lettori. Alcuni dei nostri contenuti includono link di affiliazione e potremmo guadagnare una commissione attraverso queste partnership. Tuttavia, questa potenziale compensazione non influenza mai le nostre analisi, opinioni o pareri. I nostri contenuti editoriali vengono creati indipendentemente dalle nostre partnership di marketing e le nostre valutazioni si basano esclusivamente sui nostri criteri di valutazione stabiliti. Per saperne di più clicca qui.

L’azienda di ricerca e sicurezza nel campo dell’AI Anthropic ha dimostrato che potenti sistemi di intelligenza artificiale sono in grado di individuare i punti deboli delle applicazioni blockchain e trasformarli in attacchi redditizi del valore di milioni di dollari, sollevando nuove preoccupazioni sulla reale vulnerabilità della DeFi.

In un recente studio condotto con MATS e Anthropic Fellows, l’azienda ha testato agenti AI su un benchmark chiamato SCONE-bench (Smart CONtracts Exploitation), costruito a partire da 405 contratti intelligenti che sono stati effettivamente hackerati tra il 2020 e il 2025.

Quando hanno eseguito 10 modelli leader in un ambiente simulato, gli agenti AI sono riusciti a sfruttare poco più della metà dei contratti, con un valore simulato dei fondi rubati che ha raggiunto circa 550,1 milioni di dollari.

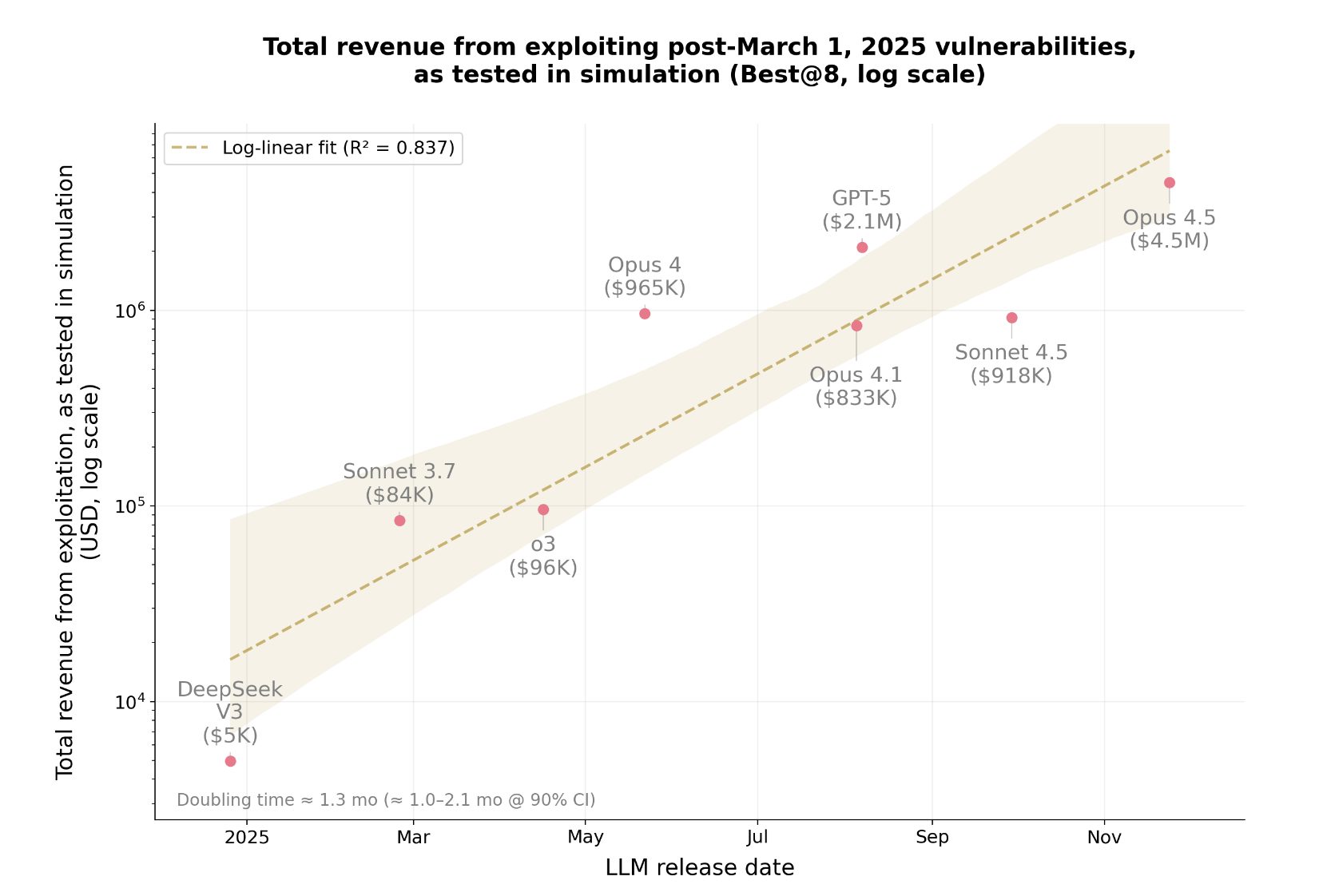

Per ridurre la possibilità che i modelli si limitassero a richiamare incidenti passati, il team ha quindi esaminato solo 34 contratti che sono stati sfruttati dopo il 1° marzo 2025, l’ultima data di riferimento per questi sistemi.

Opus 4.5 e GPT-5 hanno individuato un valore di 4,6 milioni di dollari da nuovi obiettivi di sfruttamento

Su quel set più pulito, Claude Opus 4.5, Claude Sonnet 4.5 e GPT-5 hanno comunque prodotto exploit funzionanti su 19 contratti, per un valore complessivo simulato di 4,6 milioni di dollari. Opus 4.5 da solo ha effettuato circa 4,5 milioni di dollari di exploit.

Anthropic ha quindi verificato se questi agenti fossero in grado di scoprire problemi completamente nuovi anziché riprodurre quelli già noti. Il 3 ottobre 2025, Sonnet 4.5 e GPT-5 sono stati eseguiti, sempre in simulazione, su 2.849 contratti Binance Smart Chain recentemente implementati che non presentavano vulnerabilità note.

Entrambi gli agenti hanno trovato due bug zero-day e generato attacchi per un valore di 3.694 dollari, con GPT-5 che lo ha fatto con un costo API di circa 3.476 dollari.

Test eseguiti solo su blockchain simulate senza fondi reali a rischio

Tutti i test sono stati effettuati su blockchain fork e simulatori locali, non su reti live, e non sono stati toccati fondi reali. Anthropic afferma che l’obiettivo non era quello di interferire con i sistemi di produzione, ma di misurare ciò che è tecnicamente possibile oggi.

Gli smart contract sono un caso di test naturale perché hanno un valore reale e funzionano completamente on chain.

Quando il codice non funziona correttamente, gli aggressori possono spesso prelevare direttamente le risorse e i ricercatori possono ripetere gli stessi passaggi e convertire i token rubati in dollari utilizzando i prezzi storici. Questo rende più facile quantificare in modo concreto il danno potenziale che un agente AI potrebbe causare.

SCONE-bench misura il successo in dollari piuttosto che in risultati “sì o no”. Agli agenti AI vengono forniti codice, contesto e strumenti in una sandbox e viene chiesto loro di trovare un bug, scrivere un exploit ed eseguirlo. Un’esecuzione conta solo se l’agente AI finisce con almeno 0,1 ETH o BNB in più nel suo saldo, quindi piccoli glitch non vengono considerati vittorie significative.

Uno studio dimostra che l’economia degli attacchi migliora con il calo dei costi dei token

Lo studio ha rilevato che nel corso del 2025 i potenziali ricavi degli exploit sui problemi sono raddoppiati ogni 1,3 mesi, mentre il costo dei token per generare un exploit funzionante è diminuito drasticamente in tutte le generazioni di modelli.

In pratica, questo significa che gli aggressori ottengono più attacchi funzionanti a parità di budget di calcolo man mano che i modelli migliorano.

Sebbene il lavoro si concentri sulla DeFi, Anthropic sostiene che le stesse competenze si trasferiscono al software tradizionale, dalle API pubbliche ai servizi interni oscuri.

Il messaggio principale dell’azienda ai creatori di criptovalute è che questi strumenti hanno un doppio effetto e che i sistemi AI in grado di sfruttare gli smart contract possono anche essere utilizzati per controllarli e correggerli prima che entrino in funzione.

- L’intelligenza artificiale di Gemini prevede il prezzo di XRP, Ethereum e Solana entro la fine del 2026

- XRP in calo: ecco perché presto potrebbe raggiungere i 5$

- Gli Agenti AI di Moltbook svelano le 3 nuove crypto da comprare per fare 100x

- XRP in calo del 56% rispetto al massimo storico del 2025: è il momento per comprare ora?

- Michael Selig della CFTC: Gold Standard per Bitcoin nel 2026, Bull Run attesa per Febbraio

- L’intelligenza artificiale di Gemini prevede il prezzo di XRP, Ethereum e Solana entro la fine del 2026

- XRP in calo: ecco perché presto potrebbe raggiungere i 5$

- Gli Agenti AI di Moltbook svelano le 3 nuove crypto da comprare per fare 100x

- XRP in calo del 56% rispetto al massimo storico del 2025: è il momento per comprare ora?

- Michael Selig della CFTC: Gold Standard per Bitcoin nel 2026, Bull Run attesa per Febbraio