En Resumen

- Rebecca Simmonds de la Fundación Walrus afirmó que los sistemas de IA actuales carecen de verificación independiente en sus canalizaciones de datos.

- Walrus asigna IDs únicos a cada dataset; cualquier modificación genera un nuevo ID, garantizando integridad y procedencia comprobable on-chain.

- Equipos como elizaOS y Zark Lab ya adoptaron Walrus, priorizando sectores como finanzas y salud donde la auditabilidad es obligatoria.

Los modelos de IA se están volviendo más rápidos, más grandes y más capaces. Pero a medida que sus resultados comienzan a dar forma a decisiones en finanzas, atención médica, software empresarial y más, una pregunta importante necesita ser respondida: ¿realmente podemos verificar los datos y procesos detrás de esos resultados?

"La mayoría de los sistemas de IA se basan en canalizaciones de datos que nadie fuera de la organización puede verificar de forma independiente", afirma Rebecca Simmonds, Directora Ejecutiva de la Fundación Walrus, una empresa que apoya el desarrollo de la capa de datos descentralizada Walrus.

Según explica, no hay una forma estándar de confirmar de dónde provienen los datos, si fueron manipulados o qué se autorizó para su uso en la canalización. Esa brecha no solo crea riesgos de cumplimiento, sino que también socava la confianza en los resultados que produce la IA.

"Se trata de pasar de 'confía en nosotros' a 'verifica esto'", señaló Simmonds, "y ese cambio es más importante en entornos financieros, legales y regulados donde la auditabilidad no es opcional".

Por qué los registros centralizados no son suficientes

Muchas implementaciones de IA hoy en día dependen de infraestructuras centralizadas y registros de auditoría internos. Si bien estos pueden proporcionar cierta visibilidad, aún requieren confianza en la entidad que opera el sistema.

Los stakeholders externos no tienen más opción que confiar en que los registros no han sido alterados. Con una capa de datos descentralizada, la integridad está anclada criptográficamente, por lo que las partes independientes pueden verificarlos sin depender de un único operador.

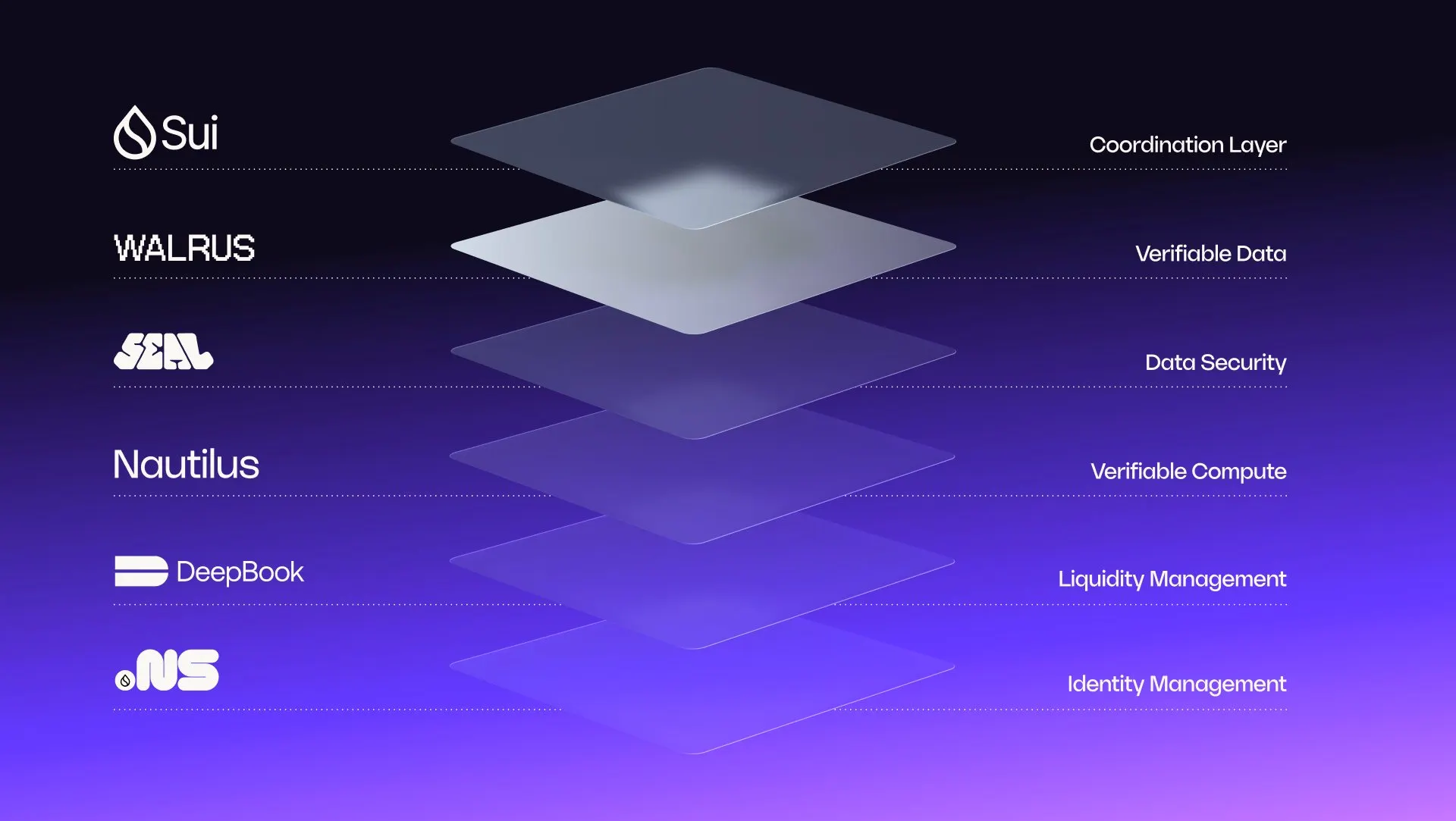

Aquí es donde Walrus se destaca, como la base de datos dentro de una arquitectura más amplia conocida como la Pila Sui. Sui en sí es una red blockchain de Capa 1 que registra eventos de políticas y recibos on-chain, coordinando el acceso y registrando la actividad verificable en toda la pila.

"Walrus es la capa de disponibilidad de datos y procedencia, donde cada conjunto de datos recibe un ID único derivado de su contenido", explicó Simmonds. "Si los datos cambian incluso por un solo byte, el ID cambia. Esto hace posible verificar que los datos en un canal de procesamiento son exactamente lo que afirman ser, no han sido alterados y siguen estando disponibles."

Otros componentes de la pila Sui se basan en esa base. Nautilus permite a los desarrolladores ejecutar cargas de trabajo de IA en un entorno seguro fuera de la cadena y generar pruebas que se pueden verificar on-chain, mientras que Seal maneja el control de acceso, permitiendo a los equipos definir y hacer cumplir quién puede ver o descifrar datos, y en qué condiciones.

"Luego, Sui une todo registrando las reglas y pruebas en la cadena", dijo Simmonds. "Esto proporciona a los desarrolladores, auditores y usuarios un registro compartido que pueden verificar de forma independiente."

"No hay una sola capa que resuelva por completo el problema de confianza de la IA", agregó. "Pero juntas, forman algo importante: una base de datos verificable para flujos de trabajo de IA: datos con procedencia comprobable, acceso que puedes hacer cumplir, computación a la que puedes dar fe, y un registro inmutable de cómo se utilizó todo".

Varios equipos de IA ya han elegido a Walrus como su plataforma de datos verificable, afirmó Simmonds, entre ellos la plataforma de agente de IA de código abierto elizaOS, y la plataforma de inteligencia de IA nativa de blockchain Zark Lab.

Autonomous agents making financial decisions on unverifiable data. Think about that for a second.

With Walrus, datasets, models, and content are verifiable by default, so builders can secure AI platforms from potential regulatory non-compliance, inaccurate responses, and erosion…

— Walrus 🦭/acc (@WalrusProtocol) February 18, 2026

Verificable, no infalible

La frase "IA verificable" puede sonar ambiciosa. Pero Simmonds es cuidadosa acerca de lo que implica y lo que no.

"La IA verificable no explica cómo un modelo razona o garantiza la veracidad de sus resultados", dijo. Pero puede "anclar flujos de trabajo a conjuntos de datos con procedencia, integridad y disponibilidad comprobables". En lugar de depender de afirmaciones de proveedores, explicó, los equipos pueden señalar un registro criptográfico de qué datos estaban disponibles y autorizados. Cuando los datos se almacenan con identificadores derivados del contenido, cada modificación produce una nueva versión rastreable, lo que permite a partes independientes confirmar qué entradas se utilizaron y cómo se manipularon.

Esta distinción es crucial. La verificabilidad no se trata de prometer resultados perfectos. Se trata de hacer transparente y auditable el ciclo de vida de los datos: cómo se almacenaron, accedieron y modificaron. Y a medida que los sistemas de IA se adentran en entornos regulados o de alto riesgo, esta transparencia se vuelve cada vez más importante.

Why does @WalrusProtocol exist.

Because businesses that need programmable storage with verifiable data integrity and guaranteed availability had nowhere to go.

We built it and they keep showing up. Simple as that!! pic.twitter.com/Ygxe8CFenh

— rebecca simmonds 🦭/acc (@RJ_Simmonds) February 12, 2026

"Las finanzas son un caso de uso apremiante", señaló Simmonds, donde "pequeños errores de datos" pueden convertirse en pérdidas reales gracias a las opacas tuberías de datos. "Poder demostrar la procedencia de los datos y la integridad a lo largo de esas tuberías es un paso significativo hacia el tipo de confianza que estos sistemas demandan", agregó, señalando que "no se limita a las finanzas. Cualquier dominio donde las decisiones tengan consecuencias, como la salud o el ámbito legal, se beneficia de una infraestructura que pueda mostrar qué datos estaban disponibles y autorizados."

Un punto de partida práctico

Para los equipos interesados en experimentar con una infraestructura verificable, Simmonds sugiere comenzar con la capa de datos como un "primer paso" en lugar de intentar una revisión completa.

"Muchas implementaciones de IA dependen de un almacenamiento centralizado que es realmente difícil de auditar de forma independiente por parte de las partes interesadas externas", dijo. "Al mover conjuntos de datos críticos a un almacenamiento con dirección de contenido como Walrus, las organizaciones pueden establecer la procedencia y disponibilidad verificables de los datos, lo cual es la base sobre la que se construye todo lo demás."

En el próximo año, uno de los enfoques de Walrus es expandir los socios y constructores en la plataforma. "Algo de lo más emocionante es lo que estamos viendo que los desarrolladores están construyendo, desde sistemas de memoria de agentes de IA descentralizados hasta nuevas herramientas para prototipar y publicar en infraestructuras verificables", afirmó. "De muchas maneras, la comunidad está liderando el camino de forma orgánica".

"Vemos a Walrus como la capa de datos en una pila de IA mucho más grande", agregó Simmonds. "No estamos tratando de ser la respuesta completa, estamos construyendo la base verificable en la que el resto de la pila depende. Cuando esa capa es correcta, se vuelven posibles nuevos tipos de flujos de trabajo de IA".